Главная страница » Блог » Этика искусственного интеллекта: принципы, риски и ответственность

Толкование снов за 1 минуту

Опиши сон — бот подскажет значение символов и возможные смыслы.

Перейти в Telegram-ботЭтика искусственного интеллекта: принципы, риски и ответственность

Содержание

- Почему этика ИИ стала важной

- Основные принципы этики искусственного интеллекта

- Главные риски искусственного интеллекта

- Примеры проблем этики ИИ

- Как решаются этические проблемы

- Регулирование искусственного интеллекта

- Этика ИИ в бизнесе

- Будущее этики искусственного интеллекта

Искусственный интеллект уже влияет на повседневную жизнь — от рекомендаций в интернете до принятия решений в бизнесе, медицине и финансах. Но вместе с ростом возможностей возникает ключевой вопрос: насколько этичны алгоритмы ИИ и можно ли им доверять?

Этика искусственного интеллекта — это область, которая изучает, как разрабатывать, внедрять и использовать ИИ так, чтобы он был безопасным, справедливым и не наносил вреда людям.

Почему этика ИИ стала важной

Раньше технологии были инструментом, но ИИ всё чаще принимает решения самостоятельно. Это означает, что ошибки могут влиять на людей напрямую:

- отказ в кредите

- решения в медицине

- автоматические блокировки аккаунтов

- рекомендации, формирующие мнение

Без этики такие системы могут быть несправедливыми, непрозрачными и даже опасными.

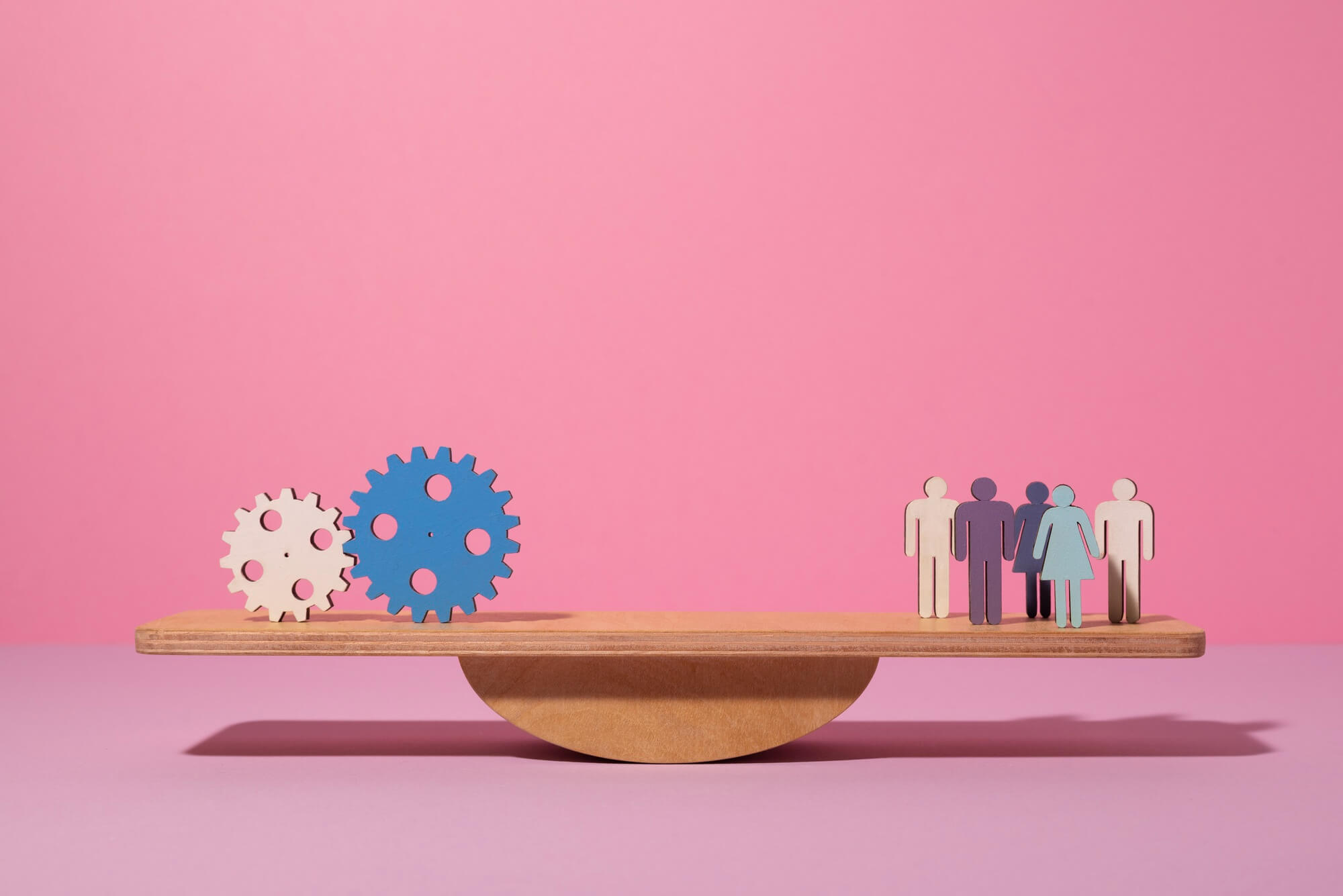

Основные принципы этики искусственного интеллекта

Справедливость

Алгоритмы должны одинаково относиться ко всем людям, независимо от пола, возраста, расы и других факторов.

Прозрачность

Пользователь должен понимать, как принимаются решения. Чёрные ящики без объяснений вызывают недоверие.

Ответственность

За решения ИИ всегда должен отвечать человек или компания, которая его использует.

Приватность

Данные пользователей должны быть защищены, а их использование — контролируемо.

Безопасность

ИИ не должен наносить вред, даже при ошибках или неправильных входных данных.

Главные риски искусственного интеллекта

Предвзятость (bias)

Если модель обучена на некачественных или односторонних данных, она может принимать несправедливые решения. Например, хуже оценивать определённые группы людей.

Галлюцинации ИИ

Нейросети могут уверенно выдавать ложную информацию, что особенно опасно в медицине и юриспруденции.

Утечка данных

ИИ может случайно раскрыть конфиденциальную информацию, если не настроены ограничения.

Зависимость от алгоритмов

Люди начинают полагаться на ИИ и меньше проверяют решения самостоятельно.

Манипуляции и дезинформация

ИИ может создавать фейковые новости, deepfake-видео и влиять на общественное мнение.

Примеры проблем этики ИИ

- алгоритмы найма, дискриминирующие кандидатов

- системы распознавания лиц с ошибками

- рекомендательные системы, усиливающие информационные пузыри

- чат-боты, распространяющие ложную информацию

Как решаются этические проблемы

Фильтрация данных

Удаление токсичных и искажённых данных из обучающих выборок.

Контроль моделей

Введение ограничений, модерации и правил поведения ИИ.

Объяснимый ИИ (Explainable AI)

Разработка методов, которые позволяют понять, как модель приняла решение.

Человеческий контроль

Критические решения должны подтверждаться человеком.

Регулирование

Во многих странах вводятся законы и стандарты использования ИИ.

Регулирование искусственного интеллекта

В 2025 году государства активно создают правила для ИИ:

- ограничения на использование данных

- обязательная прозрачность алгоритмов

- контроль высокорисковых систем

- ответственность компаний

Например, в Европе действует AI Act — один из первых комплексных законов об ИИ.

Этика ИИ в бизнесе

Для компаний важно не только использовать ИИ, но и делать это правильно:

- не нарушать приватность клиентов

- избегать дискриминации

- обеспечивать безопасность данных

- быть прозрачными в использовании ИИ

Этичный ИИ повышает доверие клиентов и снижает риски.

Будущее этики искусственного интеллекта

С развитием технологий требования к этике будут только усиливаться. В будущем:

- появятся стандарты сертификации ИИ

- усилится контроль со стороны государств

- ИИ станет более прозрачным и объяснимым

- будут внедряться встроенные механизмы безопасности

Главная цель — создать технологии, которые помогают людям, а не вредят им.

Этика искусственного интеллекта — это не ограничение, а необходимость. Без неё даже самые мощные технологии могут стать опасными. С развитием ИИ важно не только улучшать алгоритмы, но и контролировать их влияние на общество. Только так можно создать безопасный и полезный цифровой мир.

Про бизнес изнутри

Мысли, кейсы и выводы из реальной практики.

Без мотивационного шума и красивых сказок.

Подписаться на каналТакже читают